最新文章LATEST ARTICLE

前不久跟一位华为云工程师朋友聚了一下,聊到Kubernetes时,他给我分享了一个好东西,《Kubernetes学习笔记》。共973页10个章节,内容非常...

“没有网络安全就没有国家安全”。当前,网络安全已被提升到国家战略的高度,成为影响国家安全、社会稳定至关重要的因素之一。 ...

中国信息通信研究院发布的《云计算白皮书2023》显示,预计在大模型、算力等需求刺激下,市场仍将保持稳定增长,到2026年全球云计算...

在最近的一份程序员薪资报告中,Go的平均薪资位居榜首,平均薪资¥25739,Java、C++、C分别位列13、12、11名,平均薪资在¥18000-19000之间。...

作为一个程序员,必须要学习Linux。注意我说的是所有程序员,无论你是后端、前端还是算法工程师,无论你是Java、Python、PHP还是Golang&#...

MySQL一直是面试中的热点问题,也难道了很多的面试者。其实MySQL没那么难,只是大家没有系统化、实战性的过去学习、总结。同时很多开...

熟悉Docker如何提升你在构建、测试并部署Go Web应用程序的方式,并且理解如何使用Semaphore来持续部署。 简介 大多数情况下Go应用程序...

路漫漫其修远兮,吾将上下而求索。很多朋友在网络安全学习路上越走越偏,迟迟学不到系统的知识、实用的内容,相信很多网络安全学...

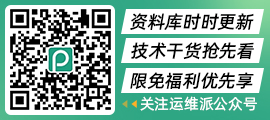

下面是一名运维人员求职数十家公司总结的运维面试题,纯纯的福利! 最新 运维面试运维面试集锦涵盖了总计1000+道面试题, 都掌...

MySQL一直是面试中的热点问题,也难为了很多的面试者,上次面试,就有人反馈面到了原题。其实MySQL没那么难,只是大家没有系统化、实...

据说今年的攻防演练马上又要开始了,很多企业都开始了前期的准备工作。 资产的梳理,暴露面收敛是前期必须做且要做好的工作。 ...

前段时间跟一位华为大佬学习,收获了一份《web安全学习笔记》,正好很久没分享干货了,这次免费分享给大家看看。 笔记一共327页,...

各大论坛和社区里也看见不少小伙伴在寻找一份完整的Linux资料,,为此咱这里帮助大家统一做一次大整理和大归类,这也算是划重点了...

今天分享一篇哔哩哔哩的视频云网络研发实习生的面经。 本篇面经偏向对计算机网络、算法、go语言的考察。 面试部门:视频云技术...

书中自有黄金屋,书中自有颜如玉。很多人学习一门技术都会看大量的书籍,经常也有朋友询问:零基础刚入门,应该看哪些书?应该怎...

对各位知友的评论做了以下总结: 1、从业人才比例机极其失衡 这点在应届生上尤为明显,很多学生愿意从事渗透测试、漏洞研究...

前言 前段时间跟一位华为大佬学习,收获了一份《web安全学习笔记》,正好最近没分享网安的干货了,这次免费分享给大家看看。笔记...

在当前技术迅速发展的时代,无论是软件开发、运维、测试、网络工程师、DBA、产品管理、项目管理、安全渗透还是架构设计等岗位,都...